Los investigadores mejoran la visión periférica de los modelos de IA

La visión periférica permite a los humanos ver formas que no están directamente en nuestra línea de visión, aunque con menos detalle. Esta capacidad amplía nuestro campo de visión y puede ser útil en muchas situaciones, como detectar un vehículo que se acerca a nuestro coche por el lateral.

A diferencia de los humanos, la IA no tiene visión periférica. Dotar a los modelos de visión artificial de esta capacidad podría ayudarles a detectar más eficazmente los peligros que se aproximan o a predecir si un conductor humano se daría cuenta de un objeto que se aproxima.

Dando un paso en esta dirección, investigadores del MIT desarrollaron un conjunto de datos de imágenes que permite simular la visión periférica en modelos de aprendizaje automático. Descubrieron que el entrenamiento de modelos con este conjunto de datos mejoraba la capacidad de los modelos para detectar objetos en la periferia visual, aunque los modelos seguían obteniendo peores resultados que los humanos.

Sus resultados también revelaron que, a diferencia de los humanos, ni el tamaño de los objetos ni la cantidad de desorden visual en una escena tenían un gran impacto en el rendimiento de la IA.

"Aquí ocurre algo fundamental. Hemos probado muchos modelos distintos e incluso cuando los entrenamos mejoran un poco, pero no son exactamente como los humanos. Así que la pregunta es: ¿qué les falta a estos modelos?", dice Vasha DuTell, postdoctorado y coautor de un artículo que detalla este estudio.

Responder a esta pregunta podría ayudar a los investigadores a crear modelos de aprendizaje automático capaces de ver el mundo como lo hacen los humanos. Además de mejorar la seguridad de los conductores, estos modelos podrían utilizarse para desarrollar pantallas más fáciles de ver.

Además, un conocimiento más profundo de la visión periférica en los modelos de IA podría ayudar a los investigadores a predecir mejor el comportamiento humano, añade la autora principal Anne Harrington MEng '23.

"Modelar la visión periférica, si realmente podemos captar la esencia de lo que se representa en la periferia, puede ayudarnos a entender las características de una escena visual que hacen que nuestros ojos se muevan para recoger más información", explica.

Entre sus coautores figuran Mark Hamilton, estudiante de postgrado de Ingeniería Eléctrica e Informática; Ayush Tewari, postdoctorando; Simon Stent, director de investigación del Instituto de Investigación Toyota; y los autores principales William T. Freeman, catedrático Thomas y Gerd Perkins de Ingeniería Eléctrica e Informática y miembro del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL); y Ruth Rosenholtz, investigadora científica principal del Departamento de Ciencias Cognitivas y del Cerebro y miembro del CSAIL. La investigación se presentará en la Conferencia Internacional sobre Aprendizaje de Representaciones.

"Cuando un ser humano interactúa con una máquina (un coche, un robot, una interfaz de usuario), es muy importante saber qué puede ver esa persona. La visión periférica desempeña un papel fundamental en esa comprensión", afirma Rosenholtz.

Simular la visión periférica

Extienda el brazo hacia delante y levante el pulgar: la pequeña zona alrededor de la uña del pulgar es la que ve la fóvea, la pequeña depresión en el centro de la retina que proporciona la visión más nítida. Todo lo demás está en la periferia visual. El córtex visual representa una escena con menos detalle y fiabilidad a medida que se aleja de ese punto de enfoque nítido.

Muchas de las aproximaciones existentes para modelar la visión periférica en IA representan este deterioro del detalle difuminando los bordes de las imágenes, pero la pérdida de información que se produce en el nervio óptico y el córtex visual es mucho más compleja.

Para lograr un enfoque más preciso, los investigadores del MIT partieron de una técnica utilizada para modelar la visión periférica en humanos. Este método, conocido como modelo de mosaico de texturas, transforma imágenes para representar la pérdida de información visual del ser humano.

Modificaron este modelo para que pudiera transformar las imágenes de forma similar, pero de una manera más flexible que no requiriera saber de antemano hacia dónde apuntarían los ojos la persona o la IA.

"Eso nos permitió modelar fielmente la visión periférica del mismo modo que se hace en la investigación de la visión humana", afirma Harrington.

Los investigadores utilizaron esta técnica modificada para generar un enorme conjunto de datos de imágenes transformadas que aparecen más texturizadas en determinadas zonas, para representar la pérdida de detalle que se produce cuando un ser humano mira más hacia la periferia.

A continuación, utilizaron el conjunto de datos para entrenar varios modelos de visión por ordenador y compararon su rendimiento con el de los humanos en una tarea de detección de objetos.

"Tuvimos que ser muy inteligentes a la hora de configurar el experimento para poder probarlo también en los modelos de aprendizaje automático. No queríamos tener que volver a entrenar los modelos en una tarea de juguete que no debían hacer", explica.

Rendimiento peculiar

A los humanos y a los modelos se les mostraron pares de imágenes transformadas que eran idénticas, salvo que una de las imágenes tenía un objeto objetivo situado en la periferia. A continuación, se pidió a cada participante que eligiera la imagen con el objeto objetivo.

"Una cosa que realmente nos sorprendió fue lo buena que era la gente detectando objetos en la periferia. Pasamos por al menos 10 conjuntos diferentes de imágenes que eran demasiado fáciles. Teníamos que utilizar objetos cada vez más pequeños", añade Harrington.

Los investigadores descubrieron que entrenar modelos desde cero con su conjunto de datos era lo que más aumentaba el rendimiento y mejoraba la capacidad de detectar y reconocer objetos. El perfeccionamiento de un modelo con su conjunto de datos, un proceso que consiste en ajustar un modelo preentrenado para que pueda realizar una nueva tarea, dio lugar a menores aumentos de rendimiento.

Pero en todos los casos, las máquinas no eran tan buenas como los humanos, y eran especialmente malas detectando objetos en la periferia lejana. Su rendimiento tampoco siguió los mismos patrones que el de los humanos.

"Eso podría sugerir que los modelos no están utilizando el contexto de la misma forma que los humanos para realizar estas tareas de detección. La estrategia de los modelos podría ser diferente", afirma Harrington.

Los investigadores planean seguir explorando estas diferencias con el objetivo de encontrar un modelo que pueda predecir el rendimiento humano en la periferia visual. Esto podría permitir, por ejemplo, que los sistemas de inteligencia artificial alertaran a los conductores de peligros que podrían no ver. También esperan inspirar a otros investigadores para que realicen más estudios de visión por ordenador con su conjunto de datos de acceso público.

Este trabajo ha sido financiado, en parte, por el Instituto de Investigación Toyota y la beca MIT CSAIL METEOR.

###

Escrito por Adam Zewe, MIT News

Articulos Electrónica Relacionados

- Proyecto MICROPLASTICS_2020 pa... AIMPLAS, Instituto Tecnológico del Plástico, está llevando a cabo, con la financiación del IVACE, el proyecto MICROPLASTICS_2020 que permitirá desarrollar una m...

- SALSA, proyecto piloto de vehí... Albufera Energy Storage lidera un proyecto para diseñar, suministrar y poner en marcha sistemas de transporte basados en vehículos eléctric...

- Una nueva tecnología que usa p... Los ingenieros de la Universidad Estatal de Oregón han inventado una manera de fabricar plata, un metal altamente conductor, para la electrónica impresa que se ...

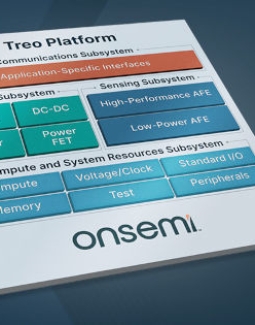

- Sistemas pequeños y potentes d... Sistemas médicos más pequeños y más potentes están impulsando las ventas de circuitos integrados, sensores y otros dispositivos para el mercado de los semicondu...

- Tres nuevas tendencias en tecn... IDTechEx ha identificado tres nuevas megatendencias en el mundo de la tecnología:• Electrónica estructural (SE)• Electrónica impr...

- Investigadores de Luxemburgo p... La investigación dirigida por la Universidad de Luxemburgo investigó el proceso de fabricación de las celdas solares. Los investigadores pr...

- El cambio hacia los vehículos ... IDTechEx ha publicado un nuevo informe técnico de investigación de mercado, "Printed and Flexible Electronics for Automotive Applications 2021-2031: Technologie...

- Propulsor eléctrico para camio... En 2021, Nikola Motor Company lanzará al mercado el Nikola One and Two, una línea de camiones de hidrógeno de clase 8 que ofrecerá m...

- El cargador tipo C reinará en ... El pasado martes, 7 de junio, el Parlamento Europeo y el Consejo llegaron a un acuerdo político para exigir, de forma obligatoria, que los dispositivos electrón...

- Estamos en un punto de inflexi... Los cambios en la industria del automóvil son un tema candente. Los avances tecnológicos están impulsando muchas tendencias y actualizaciones en los vehículos, ...

- El proyecto Precitek trata de ... El centro tecnológico Tekniker ha liderado el proyecto Precitek con el reto de conseguir robots y máquinas-herramienta más precisos a través de tecnologías avan...

- La legislación española penali... ¿Cuáles son los principales escollos que un ciudadano español tiene que salvar si quiere implantar un sistema de autoconsumo energét...